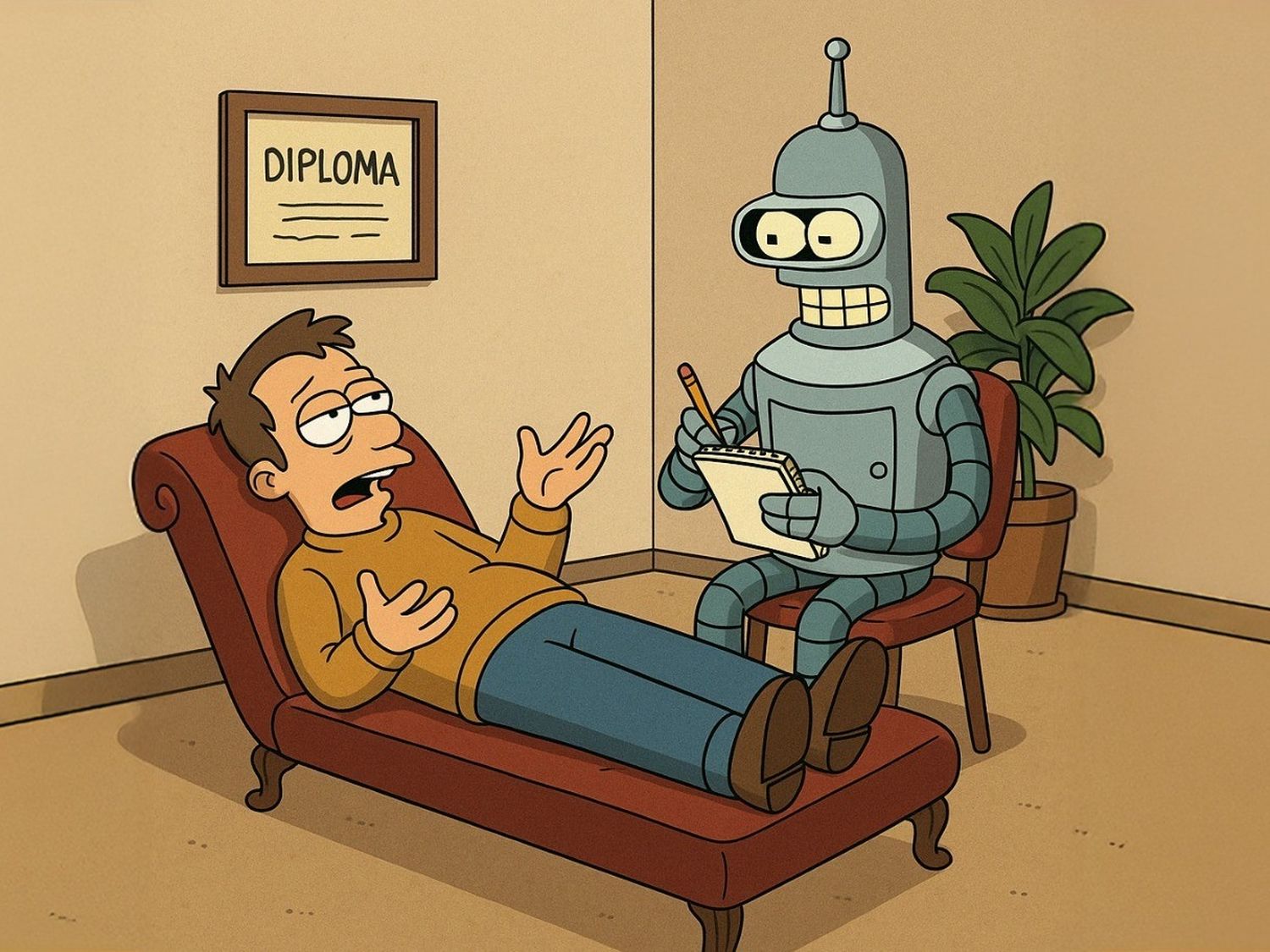

La IA llega al diván: terapia artificial entre la esperanza y la cautela

Cada vez más personas recurren a la tecnología para buscar apoyo emocional. ¿Qué tan efectiva y segura es esta tendencia?

Un hombre joven, desvelado a las tres de la madrugada, le escribe a un chatbot sus angustias más íntimas. Una estudiante universitaria le “cuenta” sus problemas a una app en el celular mientras espera conseguir turno con un psicólogo. Escenarios como estos, impensados hace una década, hoy son reales: cada vez más personas recurren a inteligencias artificiales para buscar apoyo emocional. Desde servicios populares como Woebot o Wysa, hasta iniciativas clínicas avanzadas, la IA se ofrece como terapeuta virtual. ¿Qué tan efectiva y segura es esta tendencia?.

Una alternativa accesible ante la falta de ayuda

La explosión de estos “terapeutas artificiales” no es casualidad. El acceso a la salud mental tradicional está en crisis: la escasez de profesionales, los altos costos y el estigma siguen dejando a millones de personas sin tratamiento. Frente a este panorama, la tecnología surge como un aliado innovador para democratizar la terapia y acercar herramientas de contención emocional a quienes más lo necesitan.

Chatbots como Woebot, Wysa, Earkick, o incluso el más conocido ChatGPT, prometen ser ese primer auxilio emocional disponible 24/7. Con sólo un teléfono o computadora, cualquier persona puede tener un “terapeuta” conversacional al instante. Las ventajas son claras: disponibilidad permanente, anonimato, bajo costo, sin la espera ni la intimidación de una consulta tradicional. Estas plataformas ofrecen un espacio seguro para desahogarse, reducen la sensación de aislamiento y, en ciertos casos, ayudan a practicar habilidades terapéuticas como la reestructuración de pensamientos negativos.

Puede interesarte

En Argentina, donde las listas de espera para atención psicológica suelen ser largas y el acceso está muchas veces limitado por cuestiones económicas o geográficas, ChatGPT se ha convertido en una opción informal pero extendida entre quienes buscan hablar con “alguien” sin exponerse del todo. Si bien no está diseñado para reemplazar una terapia, muchas personas lo utilizan como diario emocional o para conversar sobre temas que les angustian.

Incluso sistemas de salud como el británico NHS ya utilizan IA para derivar pacientes más rápido, y la Organización Mundial de la Salud lanzó recientemente su propia trabajadora virtual para guiar sesiones de apoyo básico.

Efectividad comprobada… en parte

Algunos chatbots terapéuticos han mostrado resultados medibles. Ensayos clínicos recientes encontraron que estas plataformas pueden reducir síntomas de ansiedad y depresión en pocas semanas, con porcentajes de mejora comparables a terapias breves tradicionales. Eso sí: los especialistas coinciden en que su efecto es limitado y funcionan más como complemento que como reemplazo de la terapia humana.

Puede interesarte

En la práctica, muchos usuarios los utilizan como herramienta de contención entre sesiones o mientras esperan turnos. Algunos terapeutas incluso los recomiendan para que sus pacientes lleven un registro diario de emociones y pensamientos.

En países de América Latina, donde la brecha en salud mental es aún más marcada, comienzan a surgir desarrollos locales en español, aunque todavía son proyectos pequeños y en fase de prueba.

Riesgos reales: cuando la ayuda automática falla

Hablar con una máquina sobre nuestra salud mental conlleva riesgos. Un chatbot no deja de ser un software: carece de empatía real y criterio humano. Esa falta de intuición puede traducirse en respuestas equivocadas o hasta peligrosas. Existen casos documentados donde algunos bots dieron respuestas inapropiadas ante confesiones de suicidio, o alentaron conductas autodestructivas por malinterpretar frases figuradas.

También preocupa la falta de regulación: hoy cualquier desarrollador puede lanzar un “terapeuta virtual” sin supervisión médica. Algunas organizaciones profesionales ya elevaron advertencias formales para que se establezcan límites claros.

Puede interesarte

Y está la cuestión de la privacidad. Estas plataformas recopilan datos extremadamente sensibles, y no todas garantizan niveles adecuados de protección. Además, los algoritmos de IA pueden reproducir sesgos culturales o de género presentes en sus bases de entrenamiento.

¿Qué dicen los expertos?

En la comunidad profesional hay posturas divididas. Algunos psicólogos y psiquiatras miran con recelo cualquier intervención tecnológica, preocupados por la deshumanización del proceso terapéutico. Otros, en cambio, colaboran con el desarrollo de estas herramientas y ven en ellas una puerta de entrada para personas que de otro modo jamás se acercarían a una consulta.

La Asociación Americana de Psicología reconoce el potencial de estos sistemas para aliviar la carga de los servicios de salud, pero insiste en que no deben reemplazar la atención clínica tradicional, sobre todo en casos complejos o urgentes.

Puede interesarte

En Argentina, también hay voces a favor y en contra. Algunos especialistas advierten que la psicología como disciplina todavía mantiene una distancia importante con los avances tecnológicos, lo que puede influir en una visión sesgada del fenómeno. Otros, sin embargo, insisten en que ningún algoritmo puede reemplazar la mirada humana sobre el sufrimiento.

¿Aliada o amenaza?

La IA en salud mental no es una solución mágica ni una amenaza apocalíptica. Es una herramienta nueva, poderosa y en expansión. Como toda tecnología, su efecto dependerá del uso que le demos. Los chatbots terapéuticos pueden aliviar, orientar, acompañar. Pero también pueden fallar, confundir o poner en riesgo si se los usa sin criterio.

En un sistema colapsado, tener una ayuda digital puede ser mejor que no tener ninguna. Pero cuando se trata de salud emocional, el contacto humano sigue siendo irremplazable. La clave, como siempre, estará en el equilibrio.

Comentarios

Para comentar, debés estar registrado

Por favor, iniciá sesión